在当今数字化时代,云计算和边缘计算作为两大重要的计算范式,正在推动着信息技术的快速发展。云计算和边缘计算代表了不同的数据处理和存储模型,各自在特定场景中发挥着重要作用。本文将深入探讨云计算与边缘计算之间的区别,着重介绍它们的定义、特点以及在各个领域的应用。

云计算

云计算是一种基于网络的计算模型,它通过将计算资源、存储服务、应用程序等提供给用户,使其能够通过互联网按需获得和使用这些资源。云计算的核心理念是将计算能力集中到大型数据中心,通过虚拟化技术实现资源的灵活分配和管理。

云计算的特点

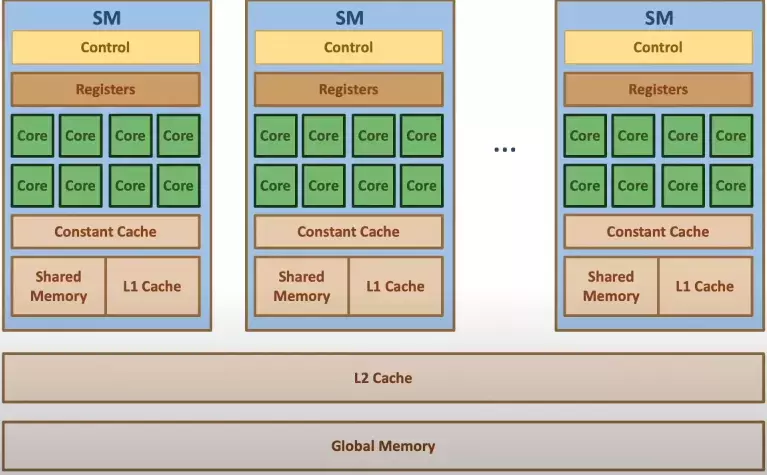

虚拟化技术: 云计算通过虚拟化技术实现硬件资源的抽象,使得用户无需关心底层硬件细节,能够更灵活地使用计算资源。

弹性和伸缩性: 云计算允许用户根据需求快速扩展或缩减计算资源,实现资源的弹性使用,避免了资源浪费。

按需服务: 用户可以按照需求购买和使用云计算提供的各种服务,无需预先投资大量资金建设自己的计算基础设施。

边缘计算

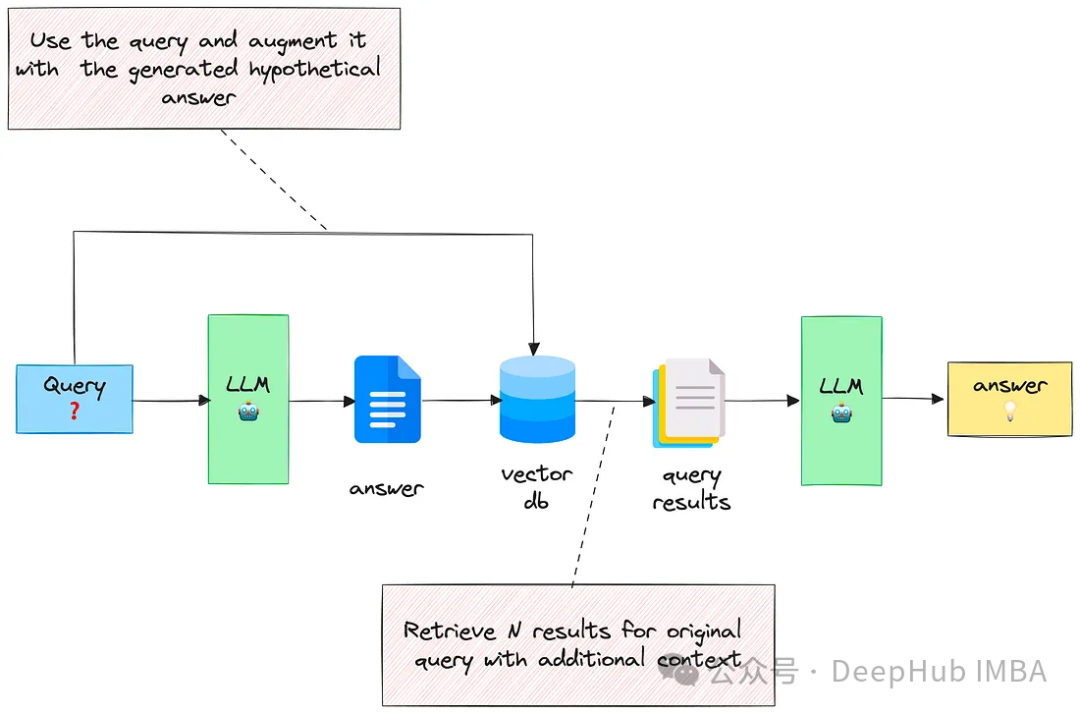

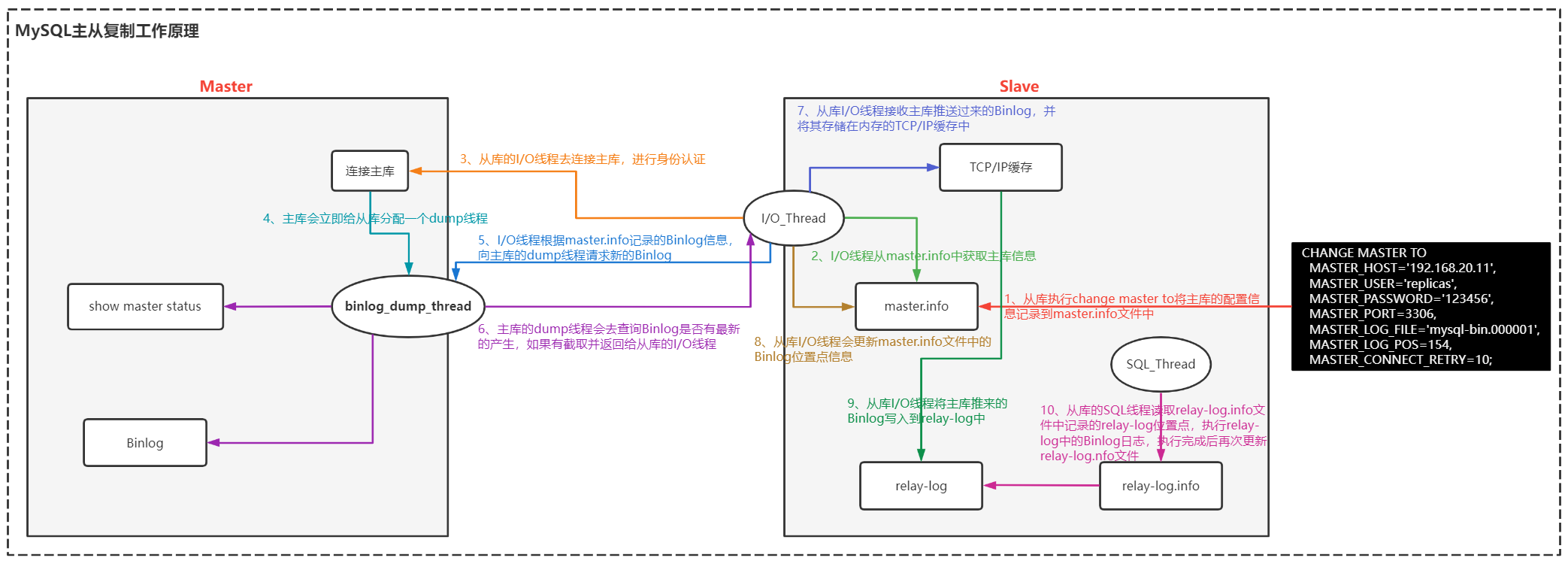

与云计算不同,边缘计算强调在数据产生源头或接近数据源的地方进行数据处理和存储。边缘计算旨在减少数据传输到中心数据中心的时间,降低延迟,提高响应速度,尤其适用于对延迟要求较高的场景。

边缘计算的特点

低延迟: 边缘计算通过在数据产生源头进行处理,减少了数据传输的距离,降低了数据传输的延迟,使得应用能够更快地响应用户请求。

数据处理在源头: 边缘计算强调在数据产生的地方进行数据处理,避免了将大量数据传输到中心数据中心进行处理,减轻了网络负担。

适用于物联网: 边缘计算特别适用于物联网场景,可以在设备端进行实时的数据分析和决策,提高了物联网系统的效率和可靠性。

云计算与边缘计算:有什么区别?

数据处理位置的差异

云计算强调将数据集中处理于中心数据中心,用户通过互联网访问和使用云提供的服务。相较之下,边缘计算将数据处理推向离数据源更近的边缘设备,如物联网设备、边缘服务器等,以实现更低延迟和更高效的数据处理。

云计算: 用户上传照片至云存储,图像处理和分析发生在云端服务器。

边缘计算: 智能摄像头在设备本地进行实时图像分析,而不是将全部数据传输到云端进行处理。

延迟和响应时间

云计算通常涉及将数据传输到远程数据中心进行处理,因此在数据传输和处理的过程中可能会出现较高的延迟。相反,边缘计算将数据处理推向更接近数据源的地方,使得在实时性要求较高的场景中能够更快速地做出响应。

云计算: 云端语音识别系统可能有更长的响应时间,因为语音数据需要传输到云端进行处理。

边缘计算: 边缘设备上的语音助手可以更迅速地响应用户指令,因为语音识别可以在本地进行。

可用性和稳定性

云计算通过大型数据中心提供服务,具有强大的计算和存储能力,但在某些情况下可能受到网络故障或数据中心故障的影响。边缘计算则通过分布在边缘设备上的计算资源提供服务,能够在某些情况下独立运行,提高了系统的可用性和稳定性。

云计算: 在网络故障时,用户可能无法访问云端应用或服务。

边缘计算: 智能传感器在断网时仍能够本地进行数据采集和处理,确保基础功能的可用性。

应用场景的不同

云计算更适用于需要大规模计算和存储的场景,例如大数据分析、人工智能训练等。而边缘计算更适用于对实时性和低延迟要求较高的场景,例如物联网、智能交通系统等。

云计算: 通过云端服务器进行大规模的数据分析,例如社交媒体数据挖掘。

边缘计算: 在智能城市中,交通信号灯通过边缘计算实时响应交通状况,优化信号灯控制。

协同应用的优势

云计算和边缘计算并非互斥,而是可以协同工作,充分发挥各自优势。通过将数据处理分布到边缘设备和云端数据中心之间,可以实现更灵活、高效的计算架构。以下是协同应用的一些优势:

低延迟和高带宽需求: 边缘计算处理实时数据,而云计算处理更大规模的数据,二者相结合可以满足低延迟和高带宽需求。

资源优化: 将部分计算任务移到边缘设备,可以减轻云端数据中心的负担,提高资源利用率。

数据安全性: 对于一些敏感数据,可以在边缘设备上进行本地处理,减少数据传输,提高数据的安全性。

在智能工厂中,传感器和设备通过边缘计算实时收集和分析生产数据,以提高生产效率。同时,云计算可用于集中管理全局数据、进行长期分析和优化。

在医疗保健领域,可通过边缘计算实时监测患者生命体征,提供快速的紧急处理。云计算则可以用于存储和分析大规模的医疗数据,支持医学研究和精准医疗。

在智能交通系统中,边缘设备如交通摄像头和传感器可实时监测交通状况,快速做出响应。云计算则可以分析历史交通数据,优化交通流,提高城市交通效率。

AWS IoT Greengrass是亚马逊提供的边缘计算服务,允许设备在边缘运行本地计算,同时与云端服务进行协同工作。这使得设备可以在断网的情况下本地运行,并在恢复连接时与云端同步数据,提高了系统的稳定性。

Azure IoT Edge是微软提供的边缘计算服务,可以在边缘设备上运行容器化的应用程序。通过Azure IoT Edge,用户可以将部分工作负载移到边缘,减少云端的负载,同时实现低延迟的数据处理。

总结

云计算和边缘计算作为不同的计算范式,各自在特定场景中发挥着独特的作用。它们的区别体现在数据处理位置、延迟、可用性以及应用场景等方面。然而,随着数字化时代的发展,它们也逐渐形成了协同应用的趋势,充分发挥各自的优势,提供更灵活、高效的计算体系结构。

未来,随着智能化、自动化和边缘计算的边界拓展,云计算和边缘计算将进一步推动数字化转型。同时,安全性、跨边缘计算标准和环境可持续性等问题也需要在未来的发展中得到更好的解决。